人工智能决策(人工智能帮助人类)

- 百科

- 2021-11-29

- 17724

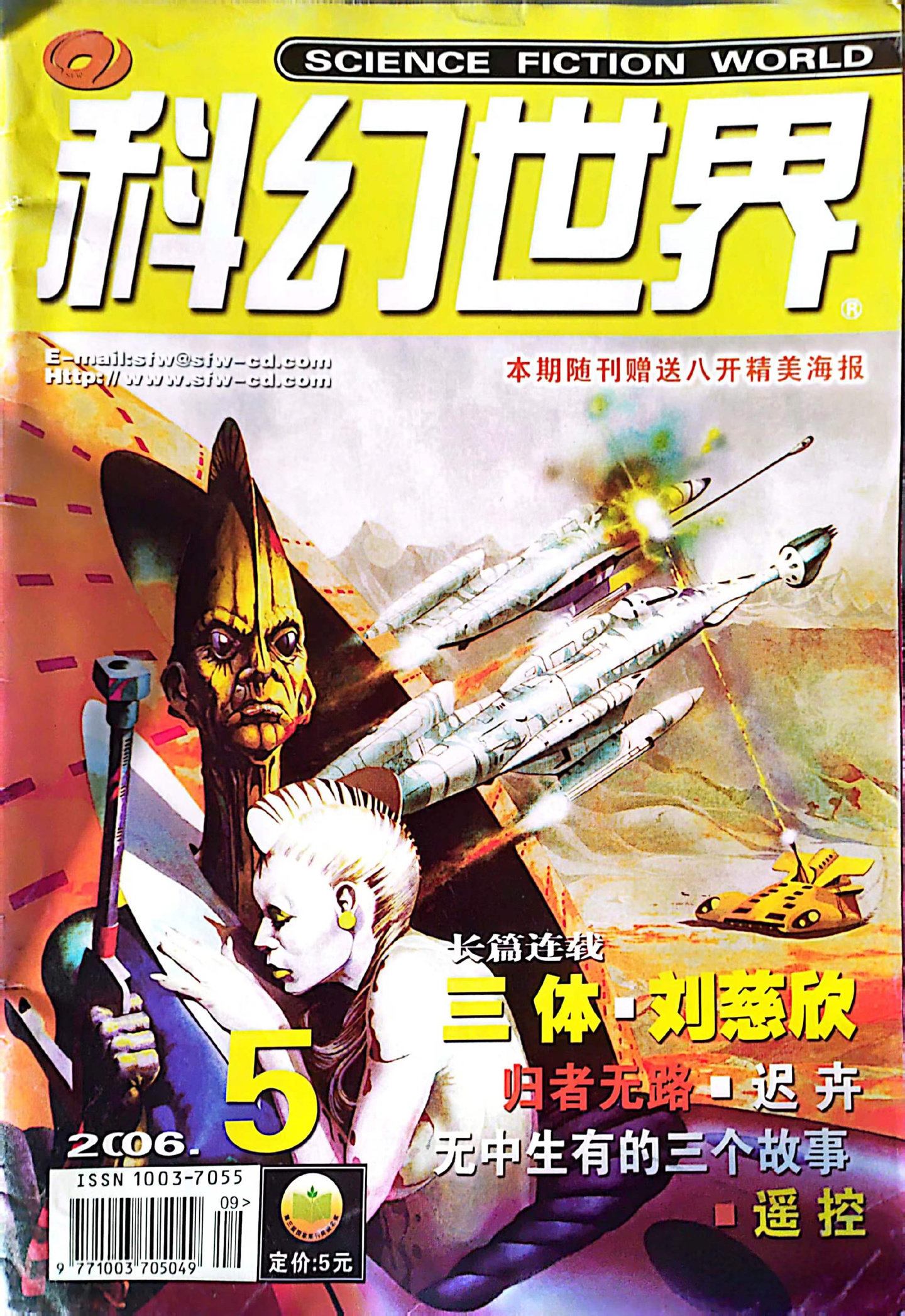

“决策智能与计算前沿论坛”上,中科院自动化所兴军亮研究员作主旨演讲。 中科院自动化所 供图

“决策智能与计算前沿论坛”上,中科院自动化所兴军亮研究员作主旨演讲。 中科院自动化所 供图

中新网北京6月22日电 (记者 孙自法)记者22日从中国科学院自动化研究所(中科院自动化所)获悉,该所南京人工智能芯片创新研究院近日举办“决策智能与计算前沿论坛”,业内众多专家学者和青年科研人员代表汇聚南京,聚焦新一代人工智能发展,共商决策智能未来发展的关键前沿理论和技术难题,促进决策智能研究方向纵深发展,推动决策智能科技与人才交流。

中科院自动化所副所长刘成林研究员指出,该所把自主进化智能作为重点投入、发展和突破的方向,在中科院人工智能创新研究院平台上,已有20余个团队开展决策智能基础理论、算法、环境、评价、应用等研究。这次论坛目的之一,就是与国内同行一起加强学术交流,探寻发展方向,寻求合作机会,共同为国家新一代人工智能发展贡献力量。

麒麟科创园管委会副主任韦斌表示,麒麟科创园将与中科院自动化所一起,面向国家在决策智能方向的战略部署和社会民生的实际需求,针对经济、民生以及重大核心产业复杂决策问题,共建具备“可评估、可推演、可解释”优势的新型AI(人工智能)重大科技基础设施。

江苏省人工智能学会秘书长房伟认为,本次论坛对促进决策智能科技与人才的交流、推动决策智能研究方向的纵深发展,必将产生深远影响。

在论坛主旨演讲环节,中国科学技术大学李厚强教授、南京大学俞扬教授、西安交通大学柯良军教授、华为诺亚方舟实验室郝建业博士、中科院自动化所兴军亮研究员等,围绕机器博弈、智能博弈、多智能体博弈、强化学习如何走出游戏等主题,分别作精彩分享。

李厚强介绍机器博弈的重要学术价值和广泛应用价值,引出机器博弈的概念及问题建模方法,并围绕机器博弈的三个研究方向博弈论、强化学习和多智能体进行理论和应用的分析,分享其课题组在机器博弈三个方向上分别取得的成果,认为未来机器博弈会向强化均衡、终身学习、可解释性等方向发展。

俞扬称,强化学习走出游戏的难点在于真实世界的场景有限,试错成本高,样本效率低等,提到基于环境模型的强化学习被认为是有望解救强化学习样本效率低下的主要途径。他指出,一旦有了良好环境模型,强化学习的大量试错可在环境模型中完成,从而极大的减少在真实环境的试错采样的数量,使得强化学习更具可用性。

柯良军从数学模型角度分别对单智能体与环境博弈问题和大、小规模疆土守卫问题进行详细讲解,指出梯度优化方法虽然可以无需训练模型即可得到纳什均衡解,但需要已知回报和智能体的动力学微分方程。此外,深度强化学习也会面临多个智能体目标冲突等问题,采用全局深度强化学习,局部博弈论是未来发展趋势。

兴军亮围绕多智能体学习的难点,针对如何从低质量的数据中学习出高水平的决策模型的问题,重点分析三种学习算法:两阶段学习算法(模仿学习+不后悔策略)、三段式学习算法(模仿学习+最优反应+迭代)和基于序列化信用分配的学习算法,并介绍这三种学习方法在星际争霸和兵棋领域的应用效果。

郝建业首先介绍深度强化学习背景与基础,然后从如何学得好、学得快、学得稳三方面介绍深度强化学习所面临的挑战及相应的解决方案,以及深度强化学习在自动驾驶控制、5G网络优化、供应链物流优化等场景的应用。

据了解,中科院自动化所南京人工智能芯片创新研究院针对国家下一代人工智能领域关键技术问题,将聚集决策智能核心人才、形成决策智能核心创新、突破决策智能核心技术,并产出面向关键民生行业的决策智能新型应用。(完)

来源:中国新闻网

本文由woniu于2021-11-29发表在中国AI网,如有疑问,请联系我们。

本文链接:https://www.chinaai.com/baike/11212.html